05 ago Pesquisa descobre brechas críticas em plataforma de IA da Nvidia

A Nvidia confirmou na última segunda-feira (04), uma lista de vulnerabilidades que colocam em risco o Nvidia Triton Inference Server. Três vulnerabilidades específicas foram divulgadas pela companhia, que quando exploradas em conjunto, apresentam um risco significativo para o ecossistema.

Essas falhas foram inicialmente descobertas pelos pesquisadores de segurança da Wiz Research. Uma possível investida por atores maliciosos pode permitir que um invasor remoto e não identificado obtenha controle total do servidor, conseguindo até mesmo executar códigos arbitrários.

Entenda: Golpes no TikTok usam histórias falsas de deportação para roubar dados

O Nvidia Triton Inference Server é uma plataforma de código aberto da gigante, utilizado primordialmente para testar e executar modelos de inteligência artificial. O grande destaque dessa plataforma é a escala grandiosa dos modelos testados, geralmente usados por empresas e desenvolvedores para gerenciar essas tecnologias.

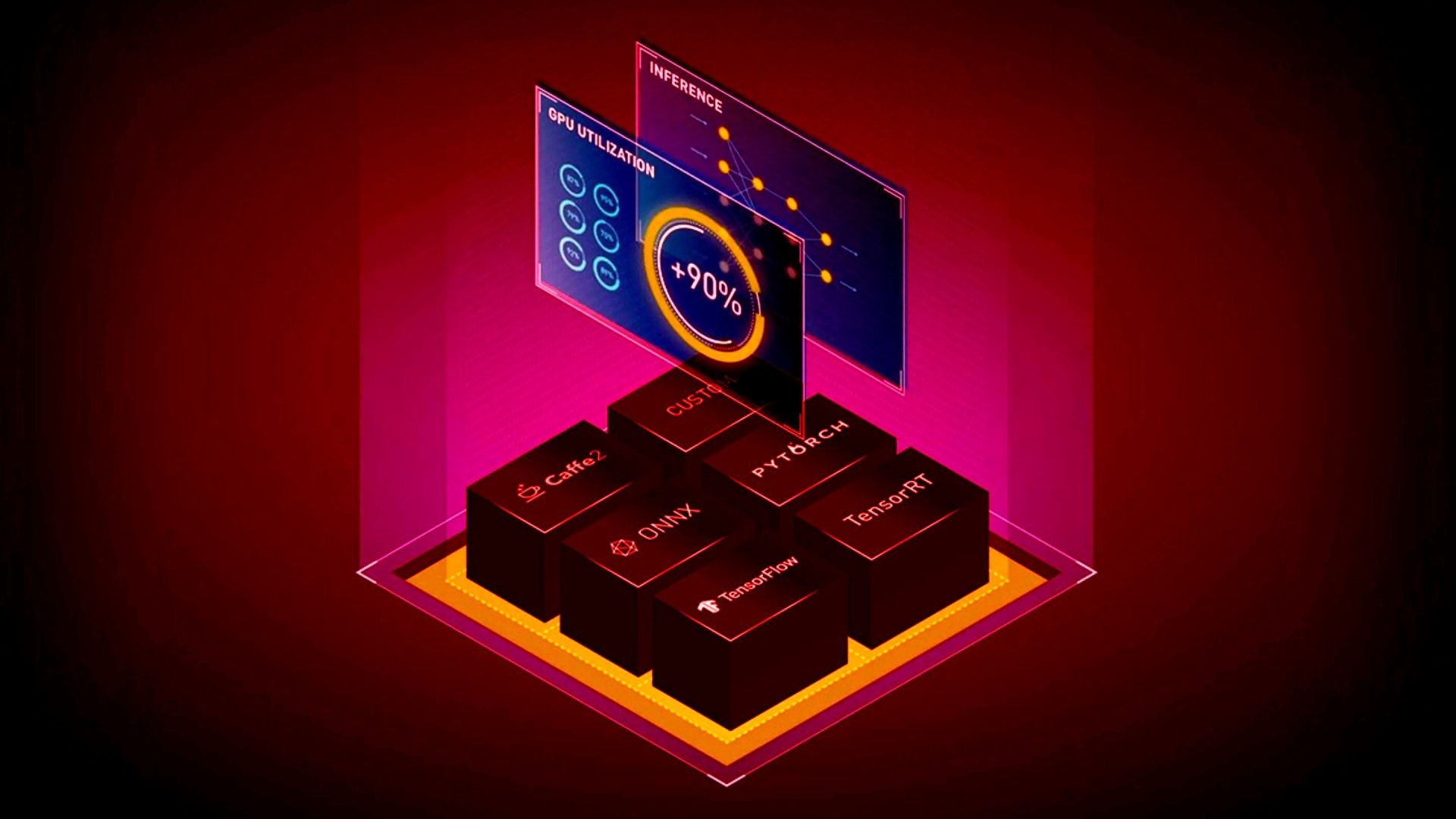

A plataforma Triton pode ser usada para executar modelos em CPUs executar modelos em CPUs x86 e Arm, GPUs NVIDIA e AWS Inferentia (Imagem: Nvidia)

Quais são e como funcionam as brechas no Nvidia Triton?

Tanto os pesquisadores da Wiz quanto a própria Nvidia confirmaram a existência de três grandes falhas que representam uma ameaça para a plataforma. Essas vulnerabilidades não são isoladas e podem começar sutilmente, mas quando unidas podem ter consequências devastadoras. Confira as brechas:

CVE-2025-23319 (Pontuação 8.1 no CVSS: Alta severidade): invasores podem causar uma falha de escrita fora dos limites, que pode ser usada para assumir o controle do servidor;CVE-2025-23320 (Pontuação 7.5 no CVSS: Alta severidade): o invasor pode enviar requisições grandes demais e exceder o limite de memória do servidor. Isso leva a condições de negação de serviço;CVE-2025-23334 (Pontuação 5.9 no CVSS: Média severidade): o invasor pode enviar uma requisição específica e utilizá-la para vazar informações confidenciais da memória do sistema.

É válido notar que todas essas falhas se iniciam no Python backend, ou seja, no motor do Nvidia Triton, por assim dizer. Isso significa que o ataque não se inicia no servidor como um todo, mas sim em uma de suas partes mais críticas e diretamente ligadas à execução dos modelos de IA.

Como mencionado acima, as brechas têm perigo quando exploradas em conjunto. Nos testes da Wiz Research, tudo começou ao explorar a falha CVE-2025-23320 para criar o erro de falha de escrita fora dos limites. Esse erro é responsável por vazar o nome completo e exclusivo do IPC (Inter-Process Communication), que deveria ser totalmente privado.

Backend de Python também lida com infraestrutura de modelos como o PyTorch e TensorFlow (Imagem: Wiz Research/Reprodução)

O problema é que esse nome funciona como um tipo de chave para dar prosseguimento ao ataque pelas duas vulnerabilidades restantes. Ao executar esses passos, é possível ganhar controle total do servidor e executar códigos arbitrários internamente.

Saiba mais: Considerado ameaça global, trojan PlayPraetor já infectou mais de 11 mil dispositivos Android

“Isso representa um risco crítico para organizações que usam Triton para IA/ML, pois um ataque bem-sucedido pode levar ao roubo de modelos valiosos de IA, à exposição de dados confidenciais, à manipulação das respostas do modelo de IA e um ponto de apoio para os invasores se aprofundarem na rede”, explicam os especialistas da Wiz.

Como se proteger das brechas?

Felizmente, a Nvidia já corrigiu essas falhas no Triton Inference Server com a atualização 25.07. É extremamente recomendado que todos os usuários da plataforma atualizem a aplicação o quanto antes, já que versões anteriores são suscetíveis a ataques.

Também é interessante notar que, apesar do alto risco envolvido, os pesquisadores não encontraram indícios de que essas brechas foram exploradas por invasores.

Para mais informações sobre segurança e como se proteger de vulnerabilidades em softwares e na internet, fique de olho no site do TecMundo.